导读从单目图像中捕捉3D人体运动是一个广泛研究的问题。使这个问题更简单的一种方法是使用环境约束和场景先验作为额外的线索。arXiv.org最近的...

从单目图像中捕捉3D人体运动是一个广泛研究的问题。使这个问题更简单的一种方法是使用环境约束和场景先验作为额外的线索。

arXiv.org最近的一篇论文指出,如果想要将重建的3D人体姿势的准确性提高到一个新的水平,则不能忽略3D场景变形。

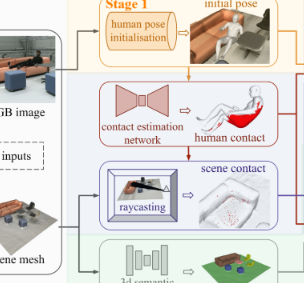

研究人员提出了MoCapDeform,这是一种用于3D单眼人体运动捕捉的新框架,具有3D场景先验。它是第一个用于从单目RGB图像中捕获联合无标记3D人体运动和捕获非刚性3D场景变形的框架。

还提出了一个新的数据集,用于具有人与场景交互和可观察场景变形的实验评估。与以前的最先进技术的比较表明,所提出的方法显着回归了更准确的全局3D人体姿势。

从单目RGB图像中捕获3D人体运动捕捉,考虑到对象与复杂且可能变形的环境的相互作用,是一个非常具有挑战性、不适定和未充分探索的问题。现有的方法只能很弱地解决它,并且不能对人类与场景表面交互时经常发生的可能的表面变形进行建模。相比之下,本文提出了MoCapDeform,即一种用于单目3D人体运动捕捉的新框架,它是第一个明确模拟3D场景的非刚性变形以改进3D人体姿态估计和可变形环境重建的新框架。MoCapDeform接受在相机空间中对齐的单目RGB视频和3D场景网格。它首先使用一种新的基于光线投射的策略来定位输入单目视频中的主题以及密集的接触标签。下一个,我们的人与环境交互约束被用来共同优化全局3D人体姿势和非刚性表面变形。MoCapDeform在多个数据集上实现了比竞争方法更高的准确性,包括我们新记录的具有变形背景场景的方法。